谷歌正借助其旗舰产品——Gemini系列(涵盖一系列前沿的生成式人工智能模型、应用及服务)引领行业潮流。那么,Gemini究竟为何物?您该如何充分利用它?相较于OpenAI的ChatGPT、Meta的Llama以及微软的Copilot等其他生成式AI工具,Gemini又表现如何呢?为了帮助您紧跟Gemini的最新动态,特此推出这份详尽指南。

Gemini是什么?

Gemini是谷歌倾力打造的下一代生成式人工智能模型系列,承载着谷歌长久以来的期待。该系列由谷歌旗下的两大人工智能研究重镇——DeepMind与谷歌研究部门联手打造,旗下囊括四大产品:

1. Gemini Ultra

2. Gemini Pro

3. Gemini Flash,作为Pro版的精简加速版,更兼具速度与效率。其更小巧、更迅捷的变体——Gemini Flash-8B,同样不容小觑。

4. Gemini Nano,这一分支则专注于轻量化设计,包括Nano-1与功能更为全面的Nano-2,二者均支持离线运行。

值得注意的是,所有Gemini模型均具备与生俱来的多模态特性,即不仅能够处理文本,更能广泛涉猎并分析音频、图像、视频等多元内容。谷歌透露,这些模型已在不同语言的文本、多种公开及专有音频、图像、视频数据集,以及一系列代码库上进行了预训练与精细调优。

此番变革,使得Gemini与谷歌此前推出的、仅基于文本数据训练的LaMDA模型大相径庭。LaMDA模型的能力局限于文本范畴,无法触及文本之外的世界(如撰写文章、发送邮件等)。然而,Gemini系列模型则不然,它们正逐步突破这一限制。

此外,我们还需审慎思考:在某些情况下,未经数据所有者许可,擅自使用公共数据进行模型训练的做法,其伦理与合法性尚存争议。谷歌虽已出台AI赔偿政策,旨在为谷歌云客户在面临诉讼时提供一定程度的保护,但该政策亦不乏例外条款。因此,在使用Gemini(尤其是商业用途)时,更应秉持谨慎态度。

Gemini应用与Gemini模型究竟有何不同?

Gemini模型与网页及移动端(原名Bard)的Gemini应用是两个相互独立、各有千秋的实体。

Gemini应用扮演着连接各类Gemini模型的重要角色,并在其基础上构建了一个类似于聊天机器人的直观界面。这些应用堪称谷歌生成式人工智能的“门面”,与ChatGPT及Anthropic的Claude系列应用有异曲同工之妙。

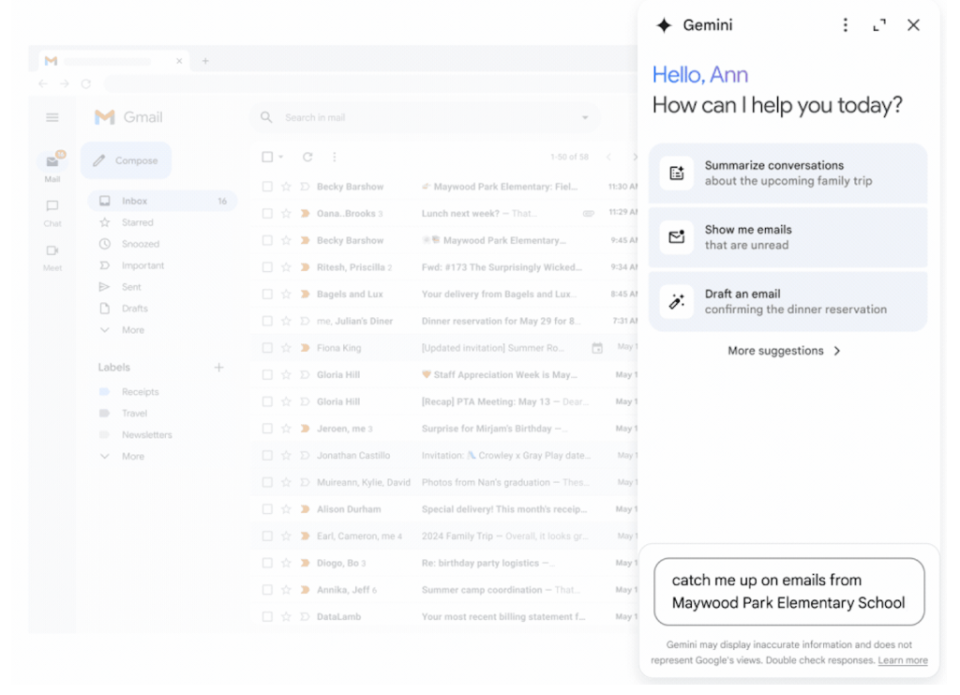

在网页端,Gemini已正式亮相。而在Android平台上,Gemini应用已悄然取代了原有的Google Assistant应用。至于iOS平台,Google应用及Google Search应用则担纲起了该平台的Gemini客户端重任。值得一提的是,Android平台最近新增了一项实用功能:用户可在任何应用上轻松叠加Gemini界面,以便就屏幕上的内容(如YouTube视频)进行提问。用户只需长按支持该功能的智能手机电源键,或轻启语音助手并说出“Hey Google”,叠加界面便会即刻呈现。Gemini应用功能强大,不仅能够接收图像、语音指令及文本(包括PDF等文件,并即将支持从Google Drive上传或导入的视频),还能生成图像。值得一提的是,若用户在同一Google帐户下同时登录了移动端与网页端,那么在这两个平台上与Gemini应用的对话将实现无缝衔接、自由切换。Gemini应用并非获取Gemini模型任务协助的唯一途径。随着时间的推移,融合了Gemini特性的功能正稳步融入Gmail、Google Docs等Google的核心应用与服务之中。为了充分利用这些功能,您将需要订阅Google One AI Premium Plan。该计划实际上是Google One的一部分,费用为20美元,它使用户能够在Google Workspace应用(如Docs、Maps、Slides、Sheets、Drive和Meet)中使用Gemini。此外,该计划还解锁了Google所谓的Gemini Advanced功能,该功能将公司更高级的Gemini模型引入Gemini应用。Gemini Advanced用户还能享受诸多额外福利,例如优先体验新功能、直接在Gemini中运行和编辑Python代码,以及更大的“上下文窗口”。Gemini Advanced能够记住并跨约75万字(或1500页文档)的对话内容进行推理,相比之下,普通版的Gemini应用仅能处理2.4万字(或48页)。Gemini Advanced还为用户提供了访问Google新推出的“深度研究”功能的权限,该功能利用“高级推理”和“长上下文能力”来生成研究报告摘要。用户向聊天机器人发出指令后,它会制定一个分步研究计划,要求用户批准,然后Gemini会花费几分钟时间在网上搜索,并根据用户的查询生成一份详尽的报告。它旨在回答更复杂的问题,例如“你能帮我重新设计厨房吗?”Google还为Gemini Advanced用户提供了记忆功能,该功能允许聊天机器人将用户与Gemini的旧对话作为当前对话的上下文。Google Search中的另一个Gemini Advanced专属功能是旅行规划,它可以根据用户的提示创建个性化的旅行行程。考虑到航班时间(从用户Gmail收件箱中的电子邮件中提取)、餐饮偏好、当地景点信息(从Google Search和Maps数据中获取)以及景点之间的距离等因素,Gemini会生成一个行程,并会根据任何变化自动更新。对于企业客户而言,还可以通过两种计划(Gemini Business和Gemini Enterprise)在Google服务中全面使用Gemini。Gemini Business是Google Workspace的附加组件,每用户每月费用低至6美元,而Gemini Enterprise(增加了会议笔记、翻译字幕以及文档分类和标记等功能)通常价格更高,但会根据企业的需求进行定价。(两种计划均要求用户做出年度承诺)。Gemini在Gmail、Docs、Chrome、开发工具及其他领域的应用在Gmail中,Gemini以侧边栏的形式存在,能够撰写邮件并总结消息线程。在Docs中,您也会看到相同的侧边栏,它能帮助您撰写和精炼内容,并激发新的创意。Gemini在Slides中能够生成幻灯片和定制图像,而在Google Sheets中,它能追踪和组织数据,创建表格和公式。Google的AI聊天机器人最近也来到了Maps,Gemini能够总结咖啡馆的评论或提供游览外国城市一天的推荐路线。Gemini的影响力同样延伸到了Drive,它能概括文件和文件夹的内容,并提供关于项目的快速事实。与此同时,在Meet中,Gemini能将字幕翻译成其他语言。 最近,Gemini以AI写作工具的形式来到了Google的Chrome浏览器。您可以用它来撰写全新的内容或重写现有文本;Google表示,它会根据您所在的网页来提出建议。在其他领域,您也能在Google的数据库产品、云安全工具和应用开发平台(包括Firebase和Project IDX)中发现Gemini的身影,以及Google Photos(Gemini处理自然语言搜索查询)、YouTube(帮助激发视频创意)和NotebookLM笔记助手等应用。Code Assist(前身为Duet AI for Developers),即Google为代码补全和生成提供的一系列AI辅助工具,正将繁重的计算任务交给Gemini来处理。同样,Google的安全产品也在Gemini的支撑下得以强化,如Gemini在威胁情报中的应用,它能分析大量潜在的恶意代码,并允许用户通过自然语言搜索正在进行的威胁或妥协指标。在2024年Google I/O大会上,Gemini宣布为高级用户推出创建Gems的功能,这是一种由Gemini模型驱动的定制聊天机器人。用户可以通过自然语言描述来生成Gems,例如,“你是我的跑步教练,给我制定一个每日跑步计划”,然后将其与他人分享或保持私密。Gems功能现已在150个国家的桌面和移动设备上,以大多数语言提供。最终,它们将能够与更多Google服务进行集成,包括Google日历、任务、记事本和YouTube音乐,以完成自定义任务。说到集成,Gemini的网页和移动应用可以通过Google所谓的“Gemini扩展”接入Google服务。目前,Gemini已与Google云端硬盘、Gmail和YouTube集成,能够回答诸如“你能帮我总结一下我最后三封邮件的内容吗?”之类的问题。今年晚些时候,Gemini还将能够与Google日历、记事本、任务、YouTube音乐和Utilities等应用进行更多交互,其中Utilities是Android独有的应用,用于控制设备上的功能,如计时器、闹钟、媒体控制、手电筒、音量、Wi-Fi、蓝牙等。Gemini Live是一种体验功能,允许用户与Gemini进行“深度”语音聊天。该功能在Gemini的移动应用和Pixel Buds Pro 2耳机上均可使用,即使手机锁屏也能访问。启用Gemini Live后,您可以在聊天机器人说话时(使用几种新的声音之一)打断它,提出澄清问题,而它将实时适应您的说话模式。在某个时刻,Gemini将具备视觉理解能力,允许它通过您智能手机摄像头拍摄的照片或视频看到并响应您的周围环境。Live还被设计为某种形式的虚拟教练,帮助您为活动进行彩排、集思广益等。例如,Live可以建议您在即将到来的工作或实习面试中突出哪些技能,它还可以提供公开发言的建议。您可以在此处阅读我们对Gemini Live的评测。剧透警告:我们认为这个功能在变得超级有用之前还有很长的路要走——但不可否认的是,现在还处于早期阶段。Gemini用户可以借助Google内置的Imagen 3模型生成艺术作品和图像。Google表示,与前代Imagen 2相比,Imagen 3能更准确地理解转化为图像的文本提示,并且生成的图像更具“创意和细节”。此外,该模型产生的伪影和视觉错误更少(至少根据Google的说法),是迄今为止在文本渲染方面表现最佳的Imagen模型。今年2月,在用户抱怨历史准确性问题后,Google被迫暂停了Gemini生成人物图像的功能。但在8月,该公司为部分用户重新引入了人物生成功能,特指作为试点项目一部分,注册了Google付费Gemini计划(如Gemini Advanced)的英语用户。今年6月,Google推出了面向青少年的Gemini体验,允许学生通过Google Workspace for Education学校账户进行注册。面向青少年的Gemini设有“额外的政策和保障措施”,包括定制化的入门流程和“AI素养指南”(Google的说法是)“帮助青少年负责任地使用AI”。除此之外,它与标准Gemini体验几乎完全相同,包括“双重检查”功能,该功能会在网络上查找以验证Gemini回答的准确性。越来越多由Google制造的设备通过Gemini增强了功能,从Google TV Streamer到Pixel 9和9 Pro,再到最新的Nest Learning Thermostat。在Google TV Streamer上,Gemini会根据您的偏好为您定制订阅内容建议,并总结评论,甚至整个季度的电视节目。在最新的Nest恒温器(以及Nest音箱、摄像头和智能显示屏)上,Gemini将很快增强Google Assistant的对话和分析能力。今年晚些时候,Google Nest Aware计划的订阅用户将预览新的Gemini功能体验,如Nest摄像头画面的AI描述、自然语言视频搜索和推荐自动化。Nest摄像头将实时理解视频流中的内容(例如,当狗在花园里挖土时),而配套的Google Home应用将根据描述呈现视频并创建设备自动化(例如,“孩子们把自行车留在车道上了吗?”、“我每周二下班回家时让Nest恒温器打开暖气”)。同样在今年晚些时候,Google Assistant将在Nest品牌和其他智能家居设备上获得几项升级,使对话感觉更加自然。除了改进的声音外,还将能够提出后续问题,并“轻松地来回切换”。由于Gemini模型具有多模态性,它们能够执行一系列多模态任务,从语音转录到实时为图像和视频添加字幕。其中许多功能已经进入到产品阶段(如前文所述),并且Google承诺在不久的将来会提供更多功能。当然,要完全相信Google的承诺有点难。在最初发布Bard时,Google就未能达到预期。最近,Google发布了一段视频,声称展示了Gemini的能力,但这段视频多少有些不切实际——并非实时演示。此外,Google并没有解决当前生成式AI技术的一些根本问题,比如其固有的偏见和编造事物(即产生幻觉)的倾向。其竞争对手也没有解决这些问题,但在考虑使用或付费使用Gemini时,这是值得注意的一点。本文假设Google最近的声明是真实的,以下是Gemini不同层级模型当前的功能以及充分发挥潜力后将具备的功能:Google表示,得益于多模态性,Gemini Ultra可用于辅助物理作业,如在工作表上逐步解决问题,并指出已填写答案中可能存在的错误。Google还表示,Ultra还可用于识别与问题相关的科学论文等任务。例如,该模型可以从多篇论文中提取信息,并通过生成重新创建图表所需的公式,用更及时的数据更新图表。Gemini Ultra在技术上支持图像生成。但该功能尚未融入模型的产品化版本——或许是因为该机制比ChatGPT等应用生成图像的方式更为复杂。与将提示输入图像生成器(如ChatGPT使用的DALL-E 3)不同,Gemini能够“原生”地输出图像,无需中间步骤。Ultra可通过Vertex AI(Google的全托管AI开发平台)和AI Studio(Google的基于网络的应用和平台开发工具)作为API使用。Google表示,Gemini Pro在推理、规划和理解能力方面较LaMDA有所提升。最新版本的Gemini 1.5 Pro——为Gemini Advanced订阅用户提供的Gemini应用提供支持——在某些方面甚至超越了Ultra的性能。与前身Gemini 1.0 Pro相比,Gemini 1.5 Pro在多个方面都有所改进,最明显的是其能够处理的数据量。Gemini 1.5 Pro可以接收多达140万字、两小时的视频或22小时的音频,并能够对这些数据进行推理或回答相关问题(或多或少)。Gemini 1.5 Pro于6月在Vertex AI和AI Studio上正式推出,同时推出了一个名为代码执行的功能,该功能旨在通过多步骤迭代精炼代码来减少模型生成的代码中的错误。(代码执行还支持Gemini Flash。)在Vertex AI中,开发人员可以通过微调或“接地”过程将Gemini Pro定制为特定上下文和用例。例如,可以指示Pro(以及其他Gemini模型)使用穆迪、汤森路透、ZoomInfo和MSCI等第三方提供商的数据,或从公司数据集或Google搜索中获取信息,而不是使用其广泛的知识库。Gemini Pro还可以连接到外部第三方API以执行特定操作,如自动化后台工作流程。AI Studio为使用Pro创建结构化聊天提示提供了模板。开发人员可以控制模型的创意范围,并提供示例以给出语调和风格指令——还可以调整Pro的安全设置。Vertex AI Agent Builder允许用户在Vertex AI中构建由Gemini提供支持的“代理”。例如,一家公司可以创建一个代理,该代理分析以前的营销活动以了解品牌风格,然后将这些知识应用于帮助生成与该风格一致的新想法。虽然Gemini Flash的第一个版本是为要求较低的工作负载而设计的,但最新版本2.0 Flash现已成为Google的旗舰AI模型。Google称Gemini 2.0 Flash为代理时代的AI模型。该模型除了能够生成文本外,还能够原生地生成图像和音频,并且可以使用Google搜索等工具并与外部API进行交互。2.0 Flash模型比Gemini的前代模型更快,甚至在衡量编码和图像分析的基准测试中,其表现也优于一些更大的Gemini 1.5模型。您可以在Gemini的网页版或Google的AI开发者平台上试用2.0 Flash的实验版,该模型的生产版将于1月推出。Flash是Gemini Pro的一个小巧高效的分支,专为狭窄、高频的生成式AI工作负载而构建,与Gemini Pro一样具有多模态性,意味着它能够分析音频、视频、图像和文本(但只能生成文本)。Google表示,Flash特别适合摘要和聊天应用等任务,以及图像和视频字幕制作和从长文档和表格中提取数据。使用Flash和Pro的开发人员可以选择利用上下文缓存,这使他们能够将大量信息(例如,知识库或研究论文数据库)存储在缓存中,Gemini模型可以快速且相对便宜地访问这些信息。不过,上下文缓存费是在其他Gemini模型使用费之外额外收取的。Gemini Nano是Gemini Pro和Ultra型号的迷你版,其运行效率极高,可直接在(部分)设备上运行,而无需将数据传输至远程服务器。截至目前,Nano已应用于Pixel 8 Pro、Pixel 8、Pixel 9 Pro、Pixel 9以及Samsung Galaxy S24等设备上的多项功能,包括录音机应用中的“总结”功能和Gboard键盘中的“智能回复”功能。录音机应用允许用户一键录制并转录音频,而Gemini则能够为用户提供录制内容的摘要,涵盖对话、访谈、演讲以及其他音频片段。即使在没有信号或Wi-Fi连接的情况下,用户也能获得摘要,同时,出于隐私保护考虑,在处理过程中,任何数据都不会离开用户的手机。此外,Nano还内置于谷歌的键盘应用Gboard中,为“智能回复”功能提供支持。该功能可在用户通过WhatsApp等消息应用进行聊天时,为其推荐接下来想要说的话。在支持的设备上,Google Messages应用中的Nano驱动着“Magic Compose”功能,该功能能够按照“兴奋”、“正式”和“抒情”等风格撰写消息。谷歌表示,未来版本的Android系统将利用Nano在通话过程中向用户发出潜在的诈骗警告。Pixel手机中的全新天气应用则借助Gemini Nano生成定制化的天气预报。而谷歌的无障碍服务TalkBack也运用了Nano,为视力低下和盲障用户创建物体听觉描述。Gemini 1.0 Pro(Gemini Pro的首个版本)、1.5 Pro和Flash均可通过谷歌的Gemini API用于构建应用程序和服务,且均提供免费选项。但免费选项设有使用限制,并省略了某些功能,如上下文缓存和批处理。除此之外,Gemini型号采用按需付费的方式。以下是截至2024年9月的基准定价(不包括上下文缓存等附加组件):Gemini 1.0 Pro:每100万个输入tokens收费0.5美元,每100万个输出tokens收费1.5美元。

最近,Gemini以AI写作工具的形式来到了Google的Chrome浏览器。您可以用它来撰写全新的内容或重写现有文本;Google表示,它会根据您所在的网页来提出建议。在其他领域,您也能在Google的数据库产品、云安全工具和应用开发平台(包括Firebase和Project IDX)中发现Gemini的身影,以及Google Photos(Gemini处理自然语言搜索查询)、YouTube(帮助激发视频创意)和NotebookLM笔记助手等应用。Code Assist(前身为Duet AI for Developers),即Google为代码补全和生成提供的一系列AI辅助工具,正将繁重的计算任务交给Gemini来处理。同样,Google的安全产品也在Gemini的支撑下得以强化,如Gemini在威胁情报中的应用,它能分析大量潜在的恶意代码,并允许用户通过自然语言搜索正在进行的威胁或妥协指标。在2024年Google I/O大会上,Gemini宣布为高级用户推出创建Gems的功能,这是一种由Gemini模型驱动的定制聊天机器人。用户可以通过自然语言描述来生成Gems,例如,“你是我的跑步教练,给我制定一个每日跑步计划”,然后将其与他人分享或保持私密。Gems功能现已在150个国家的桌面和移动设备上,以大多数语言提供。最终,它们将能够与更多Google服务进行集成,包括Google日历、任务、记事本和YouTube音乐,以完成自定义任务。说到集成,Gemini的网页和移动应用可以通过Google所谓的“Gemini扩展”接入Google服务。目前,Gemini已与Google云端硬盘、Gmail和YouTube集成,能够回答诸如“你能帮我总结一下我最后三封邮件的内容吗?”之类的问题。今年晚些时候,Gemini还将能够与Google日历、记事本、任务、YouTube音乐和Utilities等应用进行更多交互,其中Utilities是Android独有的应用,用于控制设备上的功能,如计时器、闹钟、媒体控制、手电筒、音量、Wi-Fi、蓝牙等。Gemini Live是一种体验功能,允许用户与Gemini进行“深度”语音聊天。该功能在Gemini的移动应用和Pixel Buds Pro 2耳机上均可使用,即使手机锁屏也能访问。启用Gemini Live后,您可以在聊天机器人说话时(使用几种新的声音之一)打断它,提出澄清问题,而它将实时适应您的说话模式。在某个时刻,Gemini将具备视觉理解能力,允许它通过您智能手机摄像头拍摄的照片或视频看到并响应您的周围环境。Live还被设计为某种形式的虚拟教练,帮助您为活动进行彩排、集思广益等。例如,Live可以建议您在即将到来的工作或实习面试中突出哪些技能,它还可以提供公开发言的建议。您可以在此处阅读我们对Gemini Live的评测。剧透警告:我们认为这个功能在变得超级有用之前还有很长的路要走——但不可否认的是,现在还处于早期阶段。Gemini用户可以借助Google内置的Imagen 3模型生成艺术作品和图像。Google表示,与前代Imagen 2相比,Imagen 3能更准确地理解转化为图像的文本提示,并且生成的图像更具“创意和细节”。此外,该模型产生的伪影和视觉错误更少(至少根据Google的说法),是迄今为止在文本渲染方面表现最佳的Imagen模型。今年2月,在用户抱怨历史准确性问题后,Google被迫暂停了Gemini生成人物图像的功能。但在8月,该公司为部分用户重新引入了人物生成功能,特指作为试点项目一部分,注册了Google付费Gemini计划(如Gemini Advanced)的英语用户。今年6月,Google推出了面向青少年的Gemini体验,允许学生通过Google Workspace for Education学校账户进行注册。面向青少年的Gemini设有“额外的政策和保障措施”,包括定制化的入门流程和“AI素养指南”(Google的说法是)“帮助青少年负责任地使用AI”。除此之外,它与标准Gemini体验几乎完全相同,包括“双重检查”功能,该功能会在网络上查找以验证Gemini回答的准确性。越来越多由Google制造的设备通过Gemini增强了功能,从Google TV Streamer到Pixel 9和9 Pro,再到最新的Nest Learning Thermostat。在Google TV Streamer上,Gemini会根据您的偏好为您定制订阅内容建议,并总结评论,甚至整个季度的电视节目。在最新的Nest恒温器(以及Nest音箱、摄像头和智能显示屏)上,Gemini将很快增强Google Assistant的对话和分析能力。今年晚些时候,Google Nest Aware计划的订阅用户将预览新的Gemini功能体验,如Nest摄像头画面的AI描述、自然语言视频搜索和推荐自动化。Nest摄像头将实时理解视频流中的内容(例如,当狗在花园里挖土时),而配套的Google Home应用将根据描述呈现视频并创建设备自动化(例如,“孩子们把自行车留在车道上了吗?”、“我每周二下班回家时让Nest恒温器打开暖气”)。同样在今年晚些时候,Google Assistant将在Nest品牌和其他智能家居设备上获得几项升级,使对话感觉更加自然。除了改进的声音外,还将能够提出后续问题,并“轻松地来回切换”。由于Gemini模型具有多模态性,它们能够执行一系列多模态任务,从语音转录到实时为图像和视频添加字幕。其中许多功能已经进入到产品阶段(如前文所述),并且Google承诺在不久的将来会提供更多功能。当然,要完全相信Google的承诺有点难。在最初发布Bard时,Google就未能达到预期。最近,Google发布了一段视频,声称展示了Gemini的能力,但这段视频多少有些不切实际——并非实时演示。此外,Google并没有解决当前生成式AI技术的一些根本问题,比如其固有的偏见和编造事物(即产生幻觉)的倾向。其竞争对手也没有解决这些问题,但在考虑使用或付费使用Gemini时,这是值得注意的一点。本文假设Google最近的声明是真实的,以下是Gemini不同层级模型当前的功能以及充分发挥潜力后将具备的功能:Google表示,得益于多模态性,Gemini Ultra可用于辅助物理作业,如在工作表上逐步解决问题,并指出已填写答案中可能存在的错误。Google还表示,Ultra还可用于识别与问题相关的科学论文等任务。例如,该模型可以从多篇论文中提取信息,并通过生成重新创建图表所需的公式,用更及时的数据更新图表。Gemini Ultra在技术上支持图像生成。但该功能尚未融入模型的产品化版本——或许是因为该机制比ChatGPT等应用生成图像的方式更为复杂。与将提示输入图像生成器(如ChatGPT使用的DALL-E 3)不同,Gemini能够“原生”地输出图像,无需中间步骤。Ultra可通过Vertex AI(Google的全托管AI开发平台)和AI Studio(Google的基于网络的应用和平台开发工具)作为API使用。Google表示,Gemini Pro在推理、规划和理解能力方面较LaMDA有所提升。最新版本的Gemini 1.5 Pro——为Gemini Advanced订阅用户提供的Gemini应用提供支持——在某些方面甚至超越了Ultra的性能。与前身Gemini 1.0 Pro相比,Gemini 1.5 Pro在多个方面都有所改进,最明显的是其能够处理的数据量。Gemini 1.5 Pro可以接收多达140万字、两小时的视频或22小时的音频,并能够对这些数据进行推理或回答相关问题(或多或少)。Gemini 1.5 Pro于6月在Vertex AI和AI Studio上正式推出,同时推出了一个名为代码执行的功能,该功能旨在通过多步骤迭代精炼代码来减少模型生成的代码中的错误。(代码执行还支持Gemini Flash。)在Vertex AI中,开发人员可以通过微调或“接地”过程将Gemini Pro定制为特定上下文和用例。例如,可以指示Pro(以及其他Gemini模型)使用穆迪、汤森路透、ZoomInfo和MSCI等第三方提供商的数据,或从公司数据集或Google搜索中获取信息,而不是使用其广泛的知识库。Gemini Pro还可以连接到外部第三方API以执行特定操作,如自动化后台工作流程。AI Studio为使用Pro创建结构化聊天提示提供了模板。开发人员可以控制模型的创意范围,并提供示例以给出语调和风格指令——还可以调整Pro的安全设置。Vertex AI Agent Builder允许用户在Vertex AI中构建由Gemini提供支持的“代理”。例如,一家公司可以创建一个代理,该代理分析以前的营销活动以了解品牌风格,然后将这些知识应用于帮助生成与该风格一致的新想法。虽然Gemini Flash的第一个版本是为要求较低的工作负载而设计的,但最新版本2.0 Flash现已成为Google的旗舰AI模型。Google称Gemini 2.0 Flash为代理时代的AI模型。该模型除了能够生成文本外,还能够原生地生成图像和音频,并且可以使用Google搜索等工具并与外部API进行交互。2.0 Flash模型比Gemini的前代模型更快,甚至在衡量编码和图像分析的基准测试中,其表现也优于一些更大的Gemini 1.5模型。您可以在Gemini的网页版或Google的AI开发者平台上试用2.0 Flash的实验版,该模型的生产版将于1月推出。Flash是Gemini Pro的一个小巧高效的分支,专为狭窄、高频的生成式AI工作负载而构建,与Gemini Pro一样具有多模态性,意味着它能够分析音频、视频、图像和文本(但只能生成文本)。Google表示,Flash特别适合摘要和聊天应用等任务,以及图像和视频字幕制作和从长文档和表格中提取数据。使用Flash和Pro的开发人员可以选择利用上下文缓存,这使他们能够将大量信息(例如,知识库或研究论文数据库)存储在缓存中,Gemini模型可以快速且相对便宜地访问这些信息。不过,上下文缓存费是在其他Gemini模型使用费之外额外收取的。Gemini Nano是Gemini Pro和Ultra型号的迷你版,其运行效率极高,可直接在(部分)设备上运行,而无需将数据传输至远程服务器。截至目前,Nano已应用于Pixel 8 Pro、Pixel 8、Pixel 9 Pro、Pixel 9以及Samsung Galaxy S24等设备上的多项功能,包括录音机应用中的“总结”功能和Gboard键盘中的“智能回复”功能。录音机应用允许用户一键录制并转录音频,而Gemini则能够为用户提供录制内容的摘要,涵盖对话、访谈、演讲以及其他音频片段。即使在没有信号或Wi-Fi连接的情况下,用户也能获得摘要,同时,出于隐私保护考虑,在处理过程中,任何数据都不会离开用户的手机。此外,Nano还内置于谷歌的键盘应用Gboard中,为“智能回复”功能提供支持。该功能可在用户通过WhatsApp等消息应用进行聊天时,为其推荐接下来想要说的话。在支持的设备上,Google Messages应用中的Nano驱动着“Magic Compose”功能,该功能能够按照“兴奋”、“正式”和“抒情”等风格撰写消息。谷歌表示,未来版本的Android系统将利用Nano在通话过程中向用户发出潜在的诈骗警告。Pixel手机中的全新天气应用则借助Gemini Nano生成定制化的天气预报。而谷歌的无障碍服务TalkBack也运用了Nano,为视力低下和盲障用户创建物体听觉描述。Gemini 1.0 Pro(Gemini Pro的首个版本)、1.5 Pro和Flash均可通过谷歌的Gemini API用于构建应用程序和服务,且均提供免费选项。但免费选项设有使用限制,并省略了某些功能,如上下文缓存和批处理。除此之外,Gemini型号采用按需付费的方式。以下是截至2024年9月的基准定价(不包括上下文缓存等附加组件):Gemini 1.0 Pro:每100万个输入tokens收费0.5美元,每100万个输出tokens收费1.5美元。

Gemini 1.5 Pro:对于不超过128K tokens的提示,每100万个输入tokens收费1.25美元;对于超过128K tokens的提示,每100万个输入tokens收费2.5美元;对于不超过128K tokens的提示,每100万个输出tokens收费5美元;对于超过128K tokens的提示,每100万个输出tokens收费10美元。Gemini 1.5 Flash:对于不超过128K tokens的提示,每100万个输入tokens收费0.075美元;对于超过128K tokens的提示,每100万个输入tokens收费0.15美元;对于不超过128K tokens的提示,每100万个输出tokens收费0.3美元;对于超过128K tokens的提示,每100万个输出tokens收费0.6美元。Gemini 1.5 Flash-8B:对于不超过128K tokens的提示,每100万个输入tokens收费0.0375美元;对于超过128K tokens的提示,每100万个输入tokens收费0.075美元;对于不超过128K tokens的提示,每100万个输出tokens收费0.15美元;对于超过128K tokens的提示,每100万个输出tokens收费0.3美元。标记是原始数据的细分部分,例如单词“fantastic”中的音节“fan”、“tas”和“tic”;100万个标记大约相当于70万字。输入是指输入到模型中的标记,而输出是指模型生成的标记。Ultra和2.0 Flash的定价尚未公布,而Nano仍处于早期访问阶段。Project Astra是谷歌DeepMind团队为创建支持实时多模态理解的AI应用程序和“代理”而付出的努力。在演示中,谷歌展示了AI模型如何同时处理实时视频和音频。谷歌于2024年12月向少数可信的测试人员发布了Project Astra的应用版本,但目前尚无更广泛发布的计划。谷歌希望将Project Astra应用于一副智能眼镜中。谷歌还于2024年12月向少数可信的测试人员提供了一款配备Project Astra和增强现实功能的眼镜原型。然而,目前尚未有明确的产品,且不清楚谷歌何时会真正推出此类产品。Project Astra目前仍是一个项目,而非产品。然而,Astra的演示揭示了谷歌希望其AI产品在未来能够实现的功能。苹果表示,它正在与Gemini和其他第三方模型进行谈判,以便在其Apple Intelligence套件中的多项功能中使用这些模型。在2024年WWDC主题演讲后,苹果高级副总裁Craig Federighi证实了与包括Gemini在内的模型合作的计划,但他没有透露更多细节。